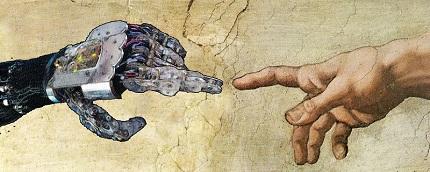

En este post continuo con los muy breves apuntes (seguramente el tema merezca un análisis mucho más profundo, pero ahora no tengo disponibilidad para ello) sobre los argumentarios acerca de la eventualidad de una máquinas éticas, en concreto, unos robots éticos o, dicho de otra manera, la posibilidad y conveniencia de que los robots sean agentes morales.

En este post continuo con los muy breves apuntes (seguramente el tema merezca un análisis mucho más profundo, pero ahora no tengo disponibilidad para ello) sobre los argumentarios acerca de la eventualidad de una máquinas éticas, en concreto, unos robots éticos o, dicho de otra manera, la posibilidad y conveniencia de que los robots sean agentes morales.En el último post aportaba 'razones a favor de los robots como agentes morales', así que ahora toca ver los argumentos en contra de los robots (o las máquinas en general) como agentes morales.

Y para ello vuelvo, como en el post anterior, a la recopilación que, al respecto, hace ello Sven Nyholm, en su libro 'This is machine ethics'.

Cuatro razones contra las máquinas éticas

En este caso, son cuatro las razones que se aportan y a las que Nyholm dedica una sección, pero que yo, simplemente, me voy a limitar enunciar:

- La moralidad no puede ser codificada completamente, es decir, la moralidad no se puede reducir a unas reglas que puedan ser implementadas en máquinas y, además, es sensible al contexto or lo que la respuesta a un problema ético puede no ser evidente.

- No es ético crear máquinas a las que permitamos tomar decisiones sobre la vida o la muerte de seres humanos, una objeción que, entiendo, no es de carácter general, sino que afecta, por ejemplo, a armas letales autónomas o, incluso, vehículos autónomos, pero no a otro tipo de maquinas sin esa capacidad real de afectar a la vida o muerte de personas.

- Los agentes morales necesitan tener emociones morales y las máquinas no las tienen. En esta visión, la ética, la propia ética humana, no es un asunto racional sino que existen las llamadas emociones morales (vergüenza, culpa, resentimiento, etc), que, sin embargo, no están presentes en las máquinas.

- Las máquinas no son capaces de actuar conforme a unos principios, a unos deseos y creencias

La verdad es que en este post, y por puros condicionantes puntuales de tiempo, no pretendía, no pretendo en realidad, hacer un análisis propio sino sólo una anotación, una consignación de argumentos, pero no puedo evitar decir que, salvo la segunda objeción, las otras tres me parecen algo débiles.

¿En qué sentido?

Pues en el sentido de que creo que se apoyan en unas limitaciones de las máquinas, los robots en el caso que me interesa, que son ciertas hoy en día, pero no tengo claro que la tecnología no pueda llegar a superar algunas de ellas. Si eso es así, los proponentes de esas objeciones ¿cambiarían de opinión?

Me hago a la idea de que no, pero su posición creo, sería entonces más débil, menos defendible y entonces, ¿Qué concluiríamos? ¿Serían posibles los robots como agentes morales? ¿Serían deseables?

Conclusiones

Hablo de conclusiones pero, en este momento no tengo verdaderas conclusiones. Sólo una interesante panorámica de razones en favor y contra.

Un buen tema para pensar, para reflexionar, para debatir... aunque no sé si seremos capaces de llegar a conclusiones.